蘋果在發佈會上,除了在 14 Pro 中,加入了全新的 4800 萬像素外,不過在數字上,即使使用 4 合 1 像素提升感光能力,光圈變小的影響下,蘋果為何仍然表示 iPhone 14 Pro 的相機在低光下,可以有 2 倍的表現?原因在於光影引擎。

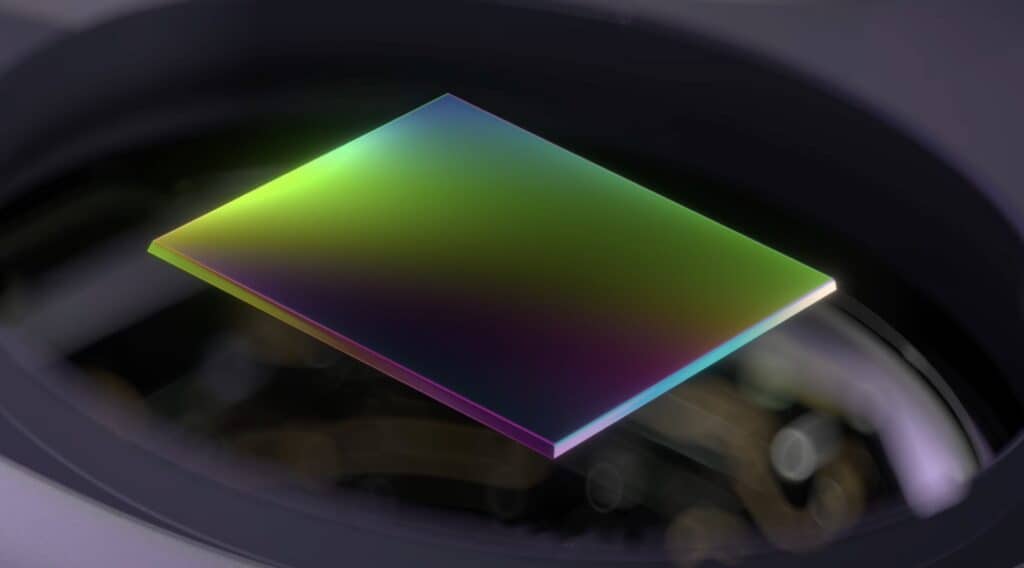

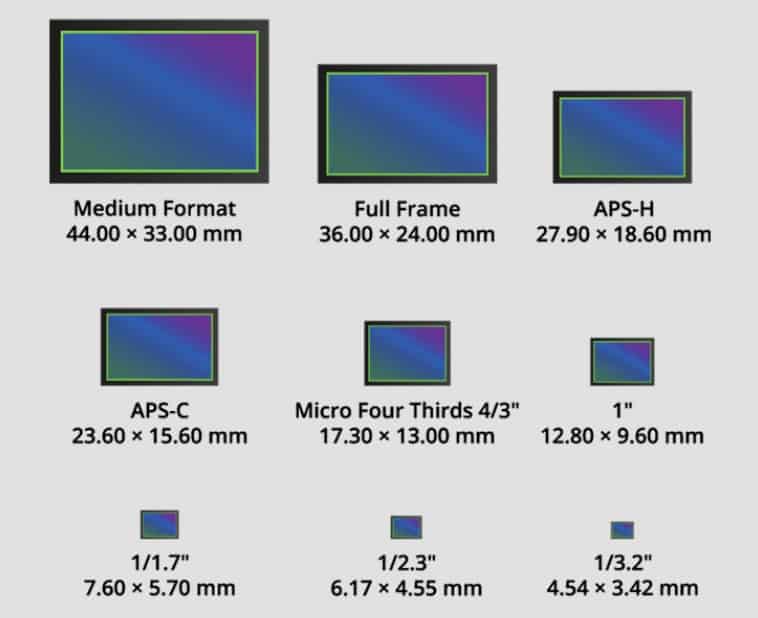

蘋果表示,iPhone 14 Pro 中,使用了4,800 萬像素主相機,配備四合一像素感應器,可以讓 1200 萬像素下,達到 2.44 微米的大小,推測使用了 1/1.33 吋的 CMOS 感光元件,正確來說實際得到的升幅,理應約為 60%,加上光圈上比上一代 iPhone 13 Pro 系列的 f1.5 更小,( 14 Pro 為 f1.78),因此要達到 2 倍效果絕對不只是在硬件上的升級。

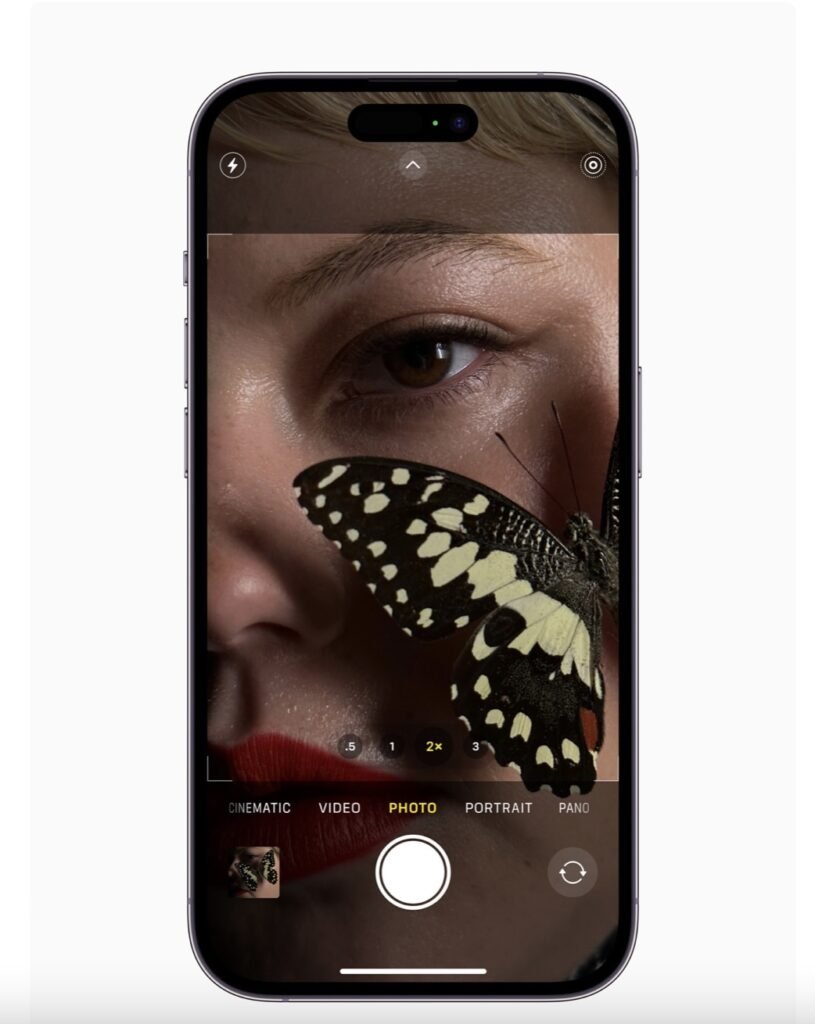

蘋果表示,新一代 iPhone 不論是 14 系列還是 14 Pro 系列,都加入了一個全新的深度整合技術,透過硬件與軟件的配合下,全新的光影引擎可以讓所有鏡頭在中至低光環境下的表現得到提升,例如 iPhone 14 的超廣角鏡即使沒有升級,亦可以提升高達 2 倍的表現,當然所有鏡頭是包括原深感測相機(即前置相機)。

光影引擎主要是在影像處理期間提前運用「深度融合」的技術,以 AI 運算,配合 A 系列處理器的相機 ISP,大幅提升相片質素,保留紋理,色彩及更多相片細節。

由於智能電話的機身大小限制,電話上的相機 CMOS 即使如何強化,對比專業相機還是有巨大的物理限制,導致電話無法達到專業相機的水平,因此為了可以減少差距,各大公司都採用了 AI 技術,配合超強的處理器,盡可能發揮機內的 CMOS 效能。

例如 iPhone 13 Pro Max 推出時,其實市面上有數款電話,使用的相機 CMOS 大小,都比 iPhone 要大,但最後 iPhone 可以在實際成像效果上,可以與他們平手,甚至可以超越這些對手,正正就是因為蘋果完全將手中的 CMOS 發揮到極限,靠軟硬件結合來補上先天的不足。