Google 今天宣佈推出其自家最先進的人工智能模型「Gemini」。Alphabet CEO Sundar Pichai 強調,AI 帶來的轉變比以往的技術轉型更為深遠。Gemini作為 Google DeepMind 的一部分,由 Google 各團隊聯手打造,旨在實現多模態整合,能無縫理解文本、音樂、圖像和影片等多種信息類型。

三種模式

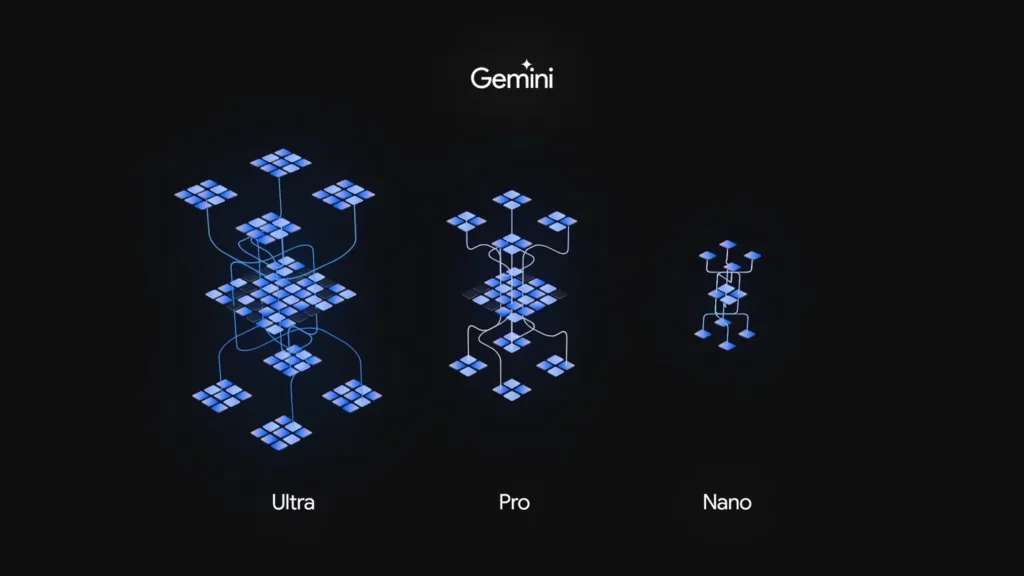

Gemini 1.0 推出三種不同模式:Ultra、Pro 和 Nano,各自針對不同任務進行優化。Ultra 在複雜任務中表現卓越,甚至在多項包括大規模多任務語言理解 (MMLU) 在內的基準測試中超越人類專家。它在多模態任務和編碼基準測試中也展示了最先進的性能。Pro 和 Nano 則分別針對跨任務擴展和設備上操作進行設計。

全方位感知能力

根據近期的性能測試,Google 的「Gemini」在視覺和聽覺互動方面展現出明顯優勢。這是有意而為之的設計:從一開始,多模態就是 Gemini 計劃的核心部分。不同於 OpenAI 分別為圖像和語音創建了 DALL-E 和 Whisper,Google 從一開始就建立了一個多感官的綜合型號。Google DeepMind CEO Demis Hassabis 表示,他們一直對非常通用的系統感興趣,尤其關注如何將不同模式結合在一起,從任何數量的輸入和感官收集數據,並以同樣豐富的方式給出回應。

從文字到多媒體

目前,Gemini 最基礎的型號是文字輸入和輸出,但更強大的型號,如 Gemini Ultra,可以處理圖像、視頻和音頻。Hassabis 透露,這只是開始,Gemini 的通用性將進一步提升,未來還將涉及動作、觸感等類似機器人技術的領域。隨著時間的推移,他說,Gemini 將獲得更多感官,變得更有意識,並在此過程中變得更準確、更扎根於現實。「這些型號將更好地理解周圍的世界」。當然,這些型號仍然會產生幻覺,也有偏見和其他問題,但 Hassabis 認為,隨著它們獲取的信息越來越多,它們的表現會越來越好。

編程領域表現出色

儘管性能測試結果重要,但 Gemini 的真正能力最終將由日常用戶在使用它來激發創意、查找信息、編寫代碼等方面的體驗中得到驗證。Google 似乎特別看好 Gemini 在編程領域的應用,它使用了一種名為 AlphaCode 2 的新代碼生成系統,該系統的表現超過了 85% 的編碼競賽參與者,相較於原始 AlphaCode 的 50% 有顯著提升。Pichai 表示,用戶將在型號接觸的每一個方面注意到改進。