近日,歌手 Taylor Swift 的 Deepfake 照片在網上瘋傳,引發關於人工智能濫用的新一輪討論。此事件迫使 X(前身為 Twitter)平台封鎖了對 Taylor Swift 的搜尋功能。

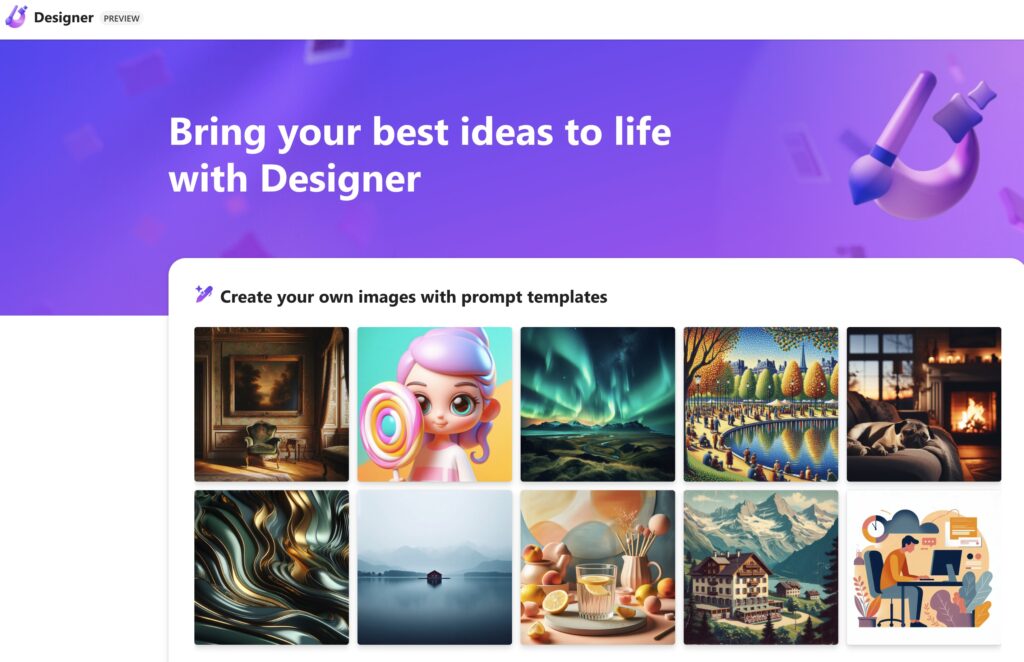

微軟對 Designer AI 進行調整

根據 404 媒體的報導,微軟對其 Designer AI 進行了更改。該 AI 據稱被 Telegram 頻道用來生成不雅影像。404 媒體的調查發現,針對名人的深偽照片可以追溯到微軟的 Designer AI。Telegram 頻道和 4chan 甚至建議用戶利用 Designer AI。

繞過 AI 安全措施

Telegram 群組建議成員使用微軟的 AI 影像生成器 Designer,用戶經常分享提示,幫助他人繞過微軟設置的保護措施。在 4chan 上出現這些影像的討論串同樣包含了如何讓微軟的 Designer 生成不雅影像的指南。

非直接在提示中使用名字

雖然微軟設有阻擋生成不雅影像的措施,但用戶通過錯拼名字或描述性行為,而非直接在提示中使用名字,成功規避了這些限制。404 媒體的測試發現,Designer 不會生成「Jennifer Aniston」的影像,但他們卻能夠使用「jennifer “actor” aniston」這樣的短語生成暗示性的影像。

在 Taylor Swift 的 AI 影像在 Twitter 上瘋傳之前,Telegram 群組中的一位用戶建議成員使用「Taylor “singer” Swift」這樣的短語來生成影像。

微軟回應:堅守負責任 AI 原則

對於 404 媒體的陳述,微軟表示,他們沒有發現 Designer AI 被用來創建 Taylor Swift 的影像。該公司發言人進一步指出:

「我們的行為準則禁止使用我們的工具創造成人或非同意的親密內容,任何反覆嘗試產生違反我們政策的內容可能會導致失去使用服務的權限。我們有大型團隊致力於開發符合我們負責任 AI 原則的安全措施,包括內容過濾、運營監控和濫用檢測,以減少系統濫用並為用戶創造更安全的環境。」